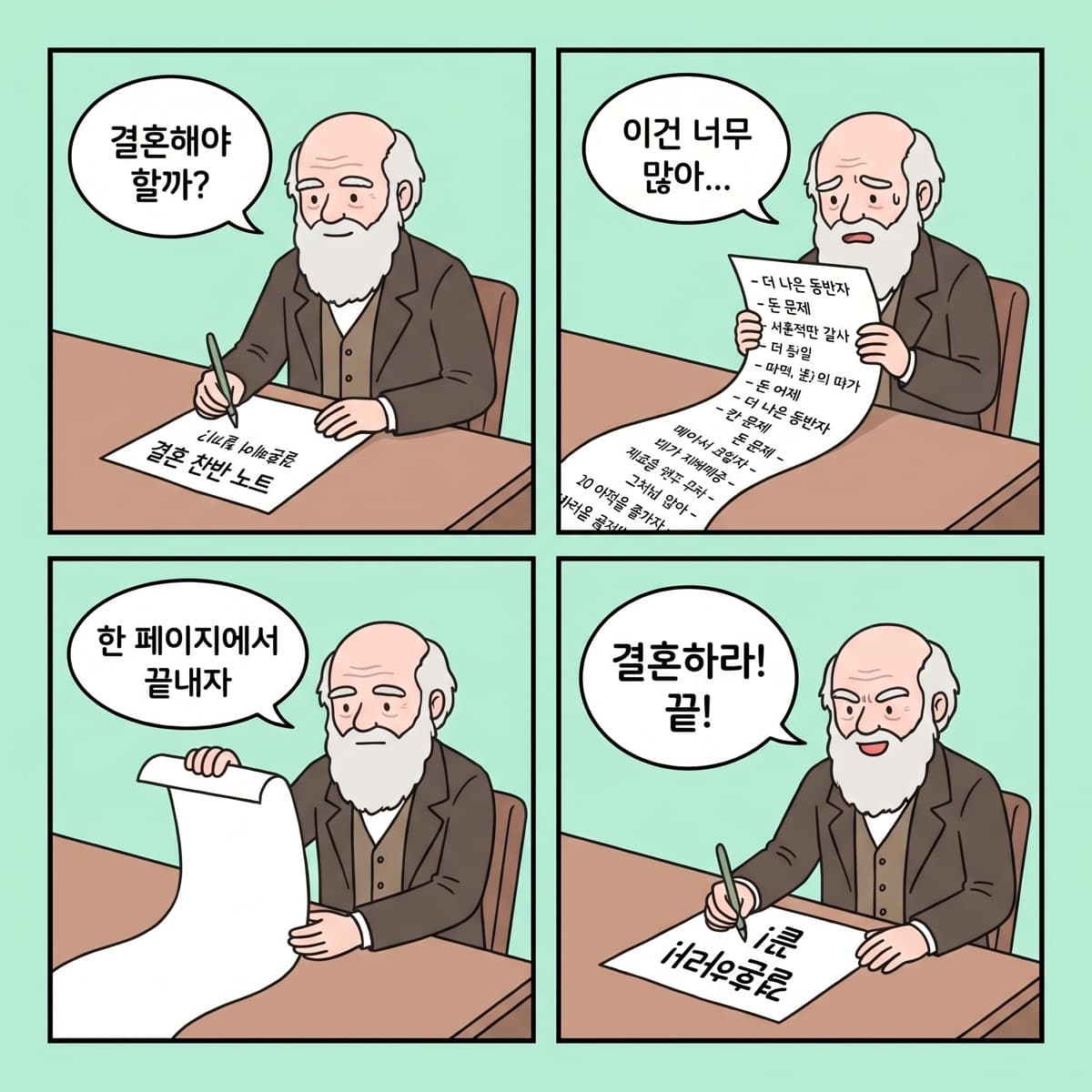

훅 — 다윈의 결혼 노트

1838년, 찰스 다윈은 사촌 Emma Wedgwood에게 청혼할지 고민하며 종이에 찬반을 적었습니다. 찬성: 자녀, 동반자, "음악과 여성 수다의 매력". 반대: "끔찍한 시간 손실", 친척 방문의 부담, 책 살 돈이 줄어듦. 결국 그는 결정합니다 — "Marry — Marry — Marry Q.E.D."

이 일화의 가장 중요한 디테일: 다윈은 일기장 한 페이지 안에서 끝냈습니다. 페이지에 정규화한 셈이죠. 더 길어졌다면 그는 결정을 내리지 못했을 것입니다.

핵심 개념

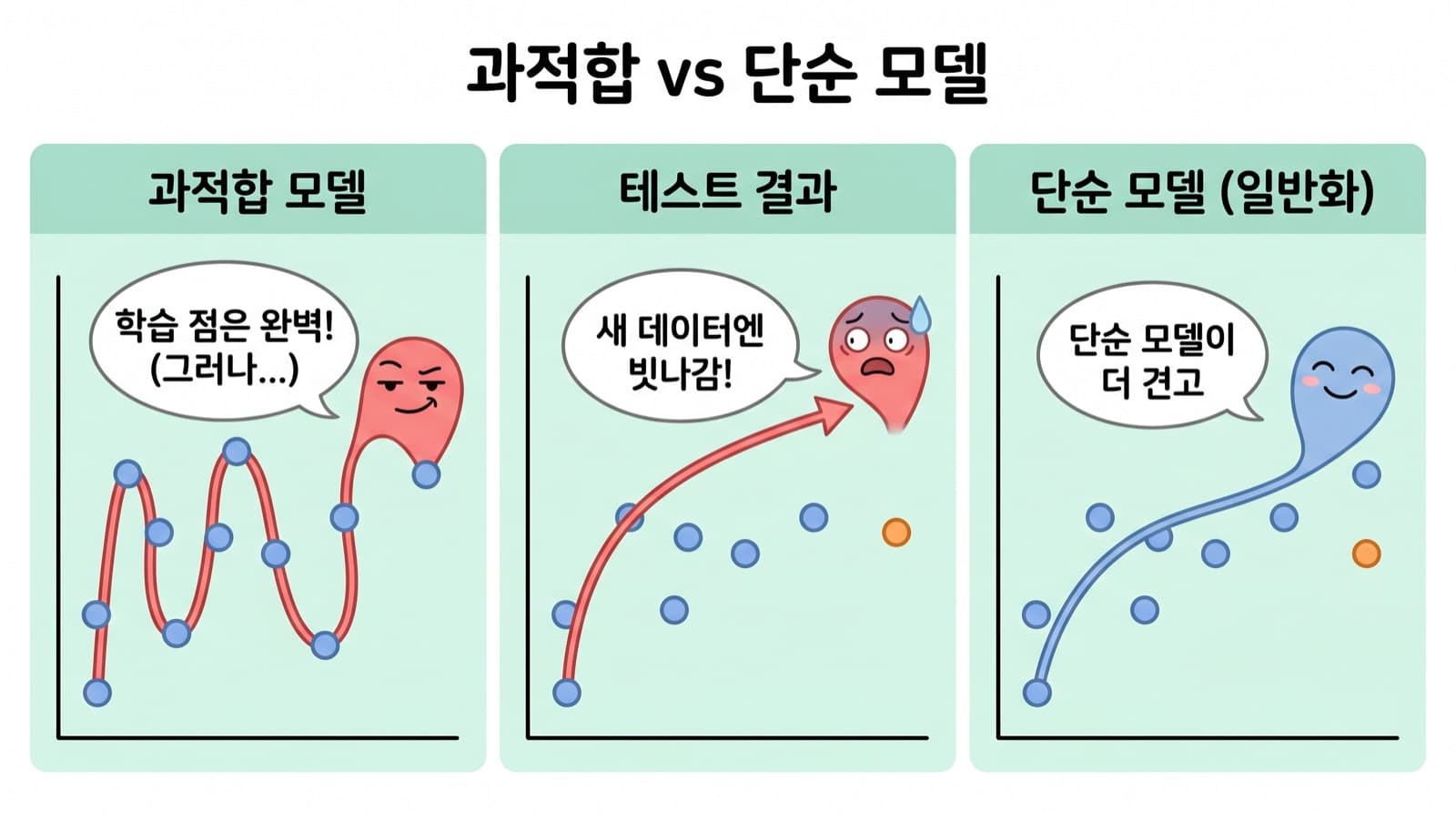

Overfitting — 너무 잘 맞는 게 문제

독일의 결혼 만족도 연구가 좋은 예입니다. 9요인 모델은 모든 데이터 점을 완벽히 통과하지만, "결혼 직전 비참함, 첫 몇 달 후 급격한 행복도 상승, 10년 후 절벽 같은 추락" 같은 비현실적 예측을 내놓습니다. 2요인 모델이 오히려 미래를 더 잘 예측했습니다.

직접 해보기

과적합 시각화

🎯 과적합 시각화

차수 2

같은 8개 학습 점에 다항식의 차수를 높여가며 맞춰봅니다. 차수가 높을수록 학습 점은 더 잘 통과하지만, 학습 점 사이에선 제멋대로 출렁여 새 데이터(테스트 점)에 대한 오차가 커집니다.

학습 오차 (RMSE)

0.128

차수↑ ⇒ 거의 0

테스트 오차 (RMSE)

0.216

차수가 너무 높으면 폭발

💡 학습 오차가 줄어도 테스트 오차가 커지는 순간이 과적합입니다. 다윈은 결혼 결정 노트를 한 페이지 안에서 끝냈습니다 — 그것이 바로 정규화입니다.

현실의 과적합 사례

현대 포트폴리오 이론(MPT)으로 1990년 노벨상을 받은 그가 정작 자기 연금은 주식과 채권에 50:50으로 분배했습니다. 이유: "주식이 폭락했을 때 모두 주식이었거나, 폭등했을 때 한 푼도 없었을 때의 후회를 최소화하고 싶었다."

전자 점수계 도입 이후 선수들이 칼끝 버튼을 살짝 휘둘러 점수를 따는 'flick' 기술에 과적합되어, 실제 결투에서는 쓸모없는 동작을 하게 됐습니다.

사격 훈련에서 탄피를 주머니에 넣는 습관이 굳어 실제 총격전 중에도 탄피를 줍다 사망한 경관들 사례. FBI는 "두 발 쏘고 자동으로 권총집에 넣는" 훈련 패턴 때문에 표적 명중 여부와 무관하게 권총을 집어넣는 사례를 발견했습니다.

한 경관은 가해자 손에서 총을 빼앗은 후, 훈련에서 그랬던 것처럼 자동으로 다시 돌려주기도 했습니다.

첫 학기에 강의 1시간당 10시간 이상 준비. 두 번째 학기엔 시간이 부족해 걱정했지만 학생 평가는 더 좋았습니다. 본인 취향을 학생 취향의 대리 지표(proxy)로 삼아 과적합한 것이 원인이었죠.

해법

Lasso · Cross-Validation · Early Stopping

Lasso (1996, Tibshirani)

모델의 복잡도(가중치 절댓값의 합)에 페널티를 추가. 영향이 작은 요인의 가중치를 0으로 끌어내려 자동으로 단순화합니다.

Cross-Validation

데이터의 일부를 일부러 빼두고('홀드아웃'), 나머지로만 학습한 뒤 빼둔 데이터로 검증. "시험을 위한 공부"를 잡아냅니다.

Early Stopping

모델이 너무 복잡해지기 전에 학습을 일찍 멈추기. 다윈이 한 페이지 안에서 결정을 내린 것과 같은 원리.

자연의 페널티

인간 두뇌는 하루 총 칼로리의 약 1/5(20%)를 소비합니다. 이는 복잡도에 대한 진화적 페널티의 증거이기도 합니다. 신진대사·시간·기억·언어가 모두 자연적 Lasso로 작동합니다.

"친구가 페이지뷰로 측정하게 두지 마라. 절대로."

실생활 적용

- 💍 큰 결정: 처음 떠오르는 2~3개 요인이 본질. 그 이후는 과적합 가능성.

- 📈 자산 운용: 확신 낮을 때는 50:50 같은 단순 분배가 합리적.

- 📊 회사 KPI: 측정 지표 자체가 목적이 되면 본질을 놓친다.

- 🎨 기획·디자인: 초기 브레인스토밍은 굵은 샤피 마커로. 정밀한 펜이 너무 일찍 디테일을 잡는다.

Reflection

고민해 볼 질문들

정답이 정해져 있지 않은 열린 질문입니다. 혼자 생각해 보거나, 가까운 사람과 함께 이야기 나눠 보세요.

- 01

당신이 너무 많은 요인으로 결정해서 오히려 흐려진 적이 있는 결정은 무엇인가요? 다윈처럼 한 페이지에서 끝낼 수 있을까요?

- 02

측정 가능한 지표가 본질을 가리고 있는 영역은 어디인가요(직장 KPI · 시험 점수 · 팔로워 수)?

- 03

'직감을 따르는 것'이 합리적인 순간이 있을까요? 어떤 영역에서 당신은 분석을 더 줄여야 할까요?

- 04

당신의 'training scars'(잘못된 환경에 과적합된 습관)는 무엇인가요? 진짜 상황에서는 쓸모없는 것은?